Crawl چیست؟ شاید این اولین سوالی باشد که به ذهن شما خطور میکند. به صورت خلاصه باید گفت Crawl به معنای خزیدن است و عملیات خزیدن رباتهای گوگل درون وبسایت شما به منظور کاوش محتوای سایت را عمل Crawl میگویند.

عملیات Crawl گوگل را بشناسیم

برای توضیح بیشتر این سوال که Crawl چیست باید گفت گوگل با هزاران ابرسرور به صورت مستمر و کامل حجم عظیمی از صفحات وب را در هر لحظه از روز بررسی میکند. ابزارهایی که به درون صفحات فرستاده میشوند تا محتوای صفحات را استخراج و برای پیمایش به سرورهای گوگل میفرستند را گوگل بات میگویند. پس اگر کسی از شما پرسید بات گوگل چیست؟ باید به او بگویید بات گوگل سربازی است که به استخدام گوگل در آمده است و اطلاعات سایتها را استخراج میکند و پس از بسته بندی به سرورهای هوشمند گوگل میفرستد. سرورهای گوگل در مرحله بعدی این اطلاعات را بررسی و پردازش کرده و برای استفاده در نتایج جستجو دسته بندی و آماده میکنند.

شاید اولین مرحله در موفقیت کسب و کار شما در موتورهای جستجو این باشد که شرایط مناسبی برای باتها و یا Crawler (خزشگر)های گوگل فراهم کنید تا بتوانند محتوای شما را به دست بگیرند. در این مطلب قصد داریم به صورت کامل و تخصصی، توضیح این بخش از ابزار گوگل سرچ کنسول را برای شما بازگو کنیم.

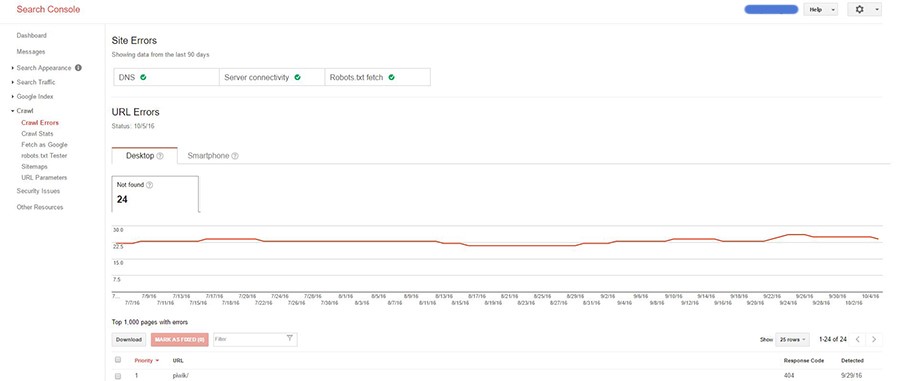

بخش Crawl Errors:

همانطور که گفتیم، اولین مرحله معروف شدن در هر کسب و کاری و یافته شدن در نتیجه جستجوی گوگل، دسترسی باتهای گوگل به محتوای سایت شماست. این بخش یعنی Crawl Errors مشکلات دسترسی به صفحات سایت شما لیست میشوند. در ضمن کد HTTP دسترسی به صفحات شما که میتواند 404، 503 و یا 200 باشد نیز حائز اهمیت است.

به صورت کلی این بخش به دو بخش تقسیم میشود. بخش Site Errors و بخش Url Errors.

بخش Site Errors: این بخش سه قسمت DNS و Server connectivity و Robots.txt fetch را به نمایش در میآورد. با کلیک بر روی هر کدام از این گزینهها نمودار و توضیحات کامل آنها نمایش داده میشوند.

بخش Url Errors: با کلیک روی لینکهای این بخش، توضیحات کاملی از دلیل خرابی لینک و صفحاتی که به این صفحه لینک داده اند را میتوانید مشاهده کنید. میتوانید با کلیک روی Mark as fixed به گوگل اعلام کنید مشکل این صفحه حل شده است و نباید در این جدول نمایش داده شود.

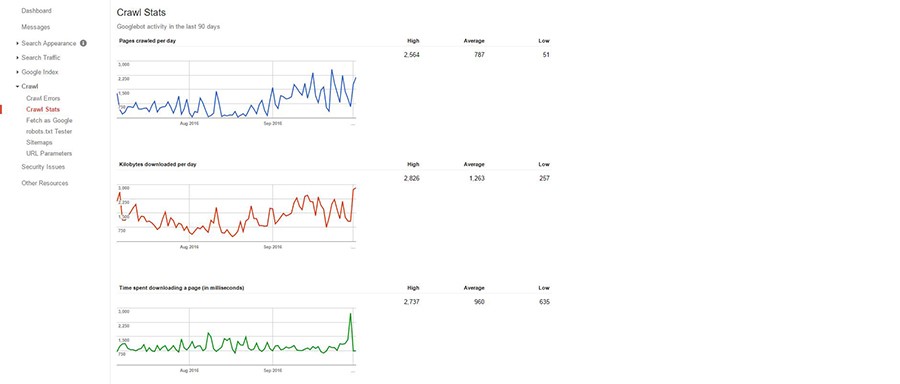

بخش Crawl Stats:

این بخش از ابزار گوگل سرچ کنسول اطلاعات کاملی از فعالیتهای خرندههای گوگل در سایت شما را نمایش میدهد.

اطلاعات این بخش در سه نمودار و در طی 90 روز گذشته نمایش داده میشوند.

نمودار Pages crawled per day: این نمودار تعداد صفحاتی که در روز در سایت شما خزیده میشوند را نمایش میدهد.

نمودار Kilobytes downloaded per day: این نمودار، میزان پهنای باندی که خزندههای گوگل در حین خزیدن درون سایت شما در یک روز استفاده میکنند را نشان میدهد.

نمودار Time spent downloading a page: این نمودار میانگین میزان سرعت دریافت صفحات شما در یک روز را بر حسب میلی ثانیه (یک هزارم ثانیه) نشان میدهد. با استفاده از این نمودار میتوانید سرعت سایت خود را بررسی کنید.

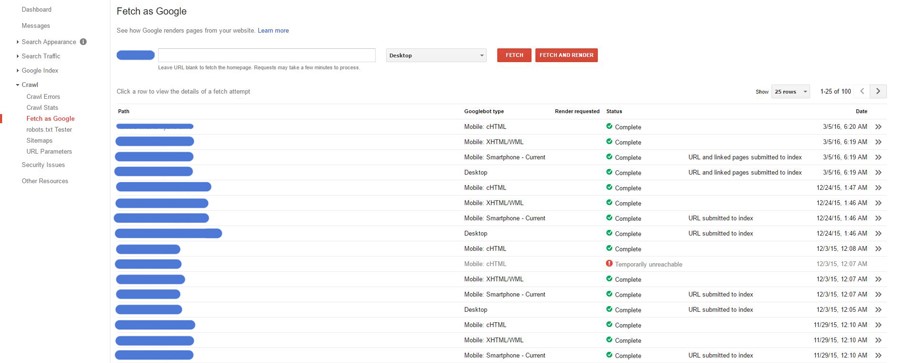

آموزش Fetch as Google ابزار Google Search Console

یکی از امکانات جالب و کاربردی ابزار گوگل سرچ کنسول همین ابزار Fetch as Google است. با این ابزار به صورت دستی لینک صفحات سایت خود را به گوگل بدهید و از گوگل بخواهید همان لحظه صفحه شما را دریافت و پردازش کند.

وقتی یک لینک به این صفحه داده و در خواست Fetch آن را میدهید، درخواست شما بررسی میشود و پس از رسیدن به نتیجه گزینه Submit to index ظاهر میشود که برای نهایی کردن عملیات باید روی آن کلیک کنیم. وقتی روی این گزینه کلیک کنیم دو حالت وجود دارد. حالت اول Crawl only this URL و حالت دوم Crawl this URL and its direct links است. حالت اول تنها لینک جاری را پردازش میکند که در ماه میتوانید 500 لینک را با این روش پردازش و اضافه کنید. حالت دوم را که تنها 10 بار در ماه میتوانید اجرا کنید قابلیت اضافه کردن لینک جاری و لینکهای درون آن را به شما میدهد.

البته چهار ربات برای بررسی صفحات وجود دارند که عبارتند از Desktop، Mobile: Smartphone، Mobile: XHTML:WML و Mobile: cHTML. در هنگام در خواست Fetch میتوانید هر کدام را که مایل بودید انتخاب کنید. چون همانطور که میدانید رتبه جستجو برای یک کلمه کلیدی در دستگاههای متفاوت ممکن است متفاوت باشد.

گزینه FETCH AND RENDER نمایشی از نحوه دیده شدن سایت شما توسط گوگل دارد، که بررسی آن کمی بیشتر از FETCH ساده طول میکشد.

استفاده زیاد از Fetch as Google:

برخی فکر میکنند اگر Fetch as Google را دستی زیاد استفاده کنید منجر به صرف نظر کردن رباتها از سایت شما میشود. این قضیه با توجه به اظهار نظر خود سایت گوگل اصلا درست نیست.

بخش robots.txt Tester و چگونگی ساخت فایل robots.txt

فایل robots.txt یک فایل مهم برای تمام موتورهای جستجوی استاندارد است. هر موتور جستجویی قبل از شروع به پیمایش سایت شما ابتدا به این فایل مراجعه کرده و شرطهای موجود در آن را بررسی میکند.

وجود این فایل الزامی نیست، ولی اگر این فایل را قرار دهید در حال صادر کردن دستورهایی برای تمام موتورهای جستجو و یا موتور خاصی هستید.

در فایل robots.txt میتوانید صفحاتی را که نمیخواهید پیمایش شوند را مشخص کنید که در ادامه آموزش این کار را ارائه میدهیم:

فایل زیر یک فایل نمونه robots.txt است:

User-agent: *

Disallow: /folder/User-agent نوع موتور جستجو را مشخص میکند. * به معنای این است که این دستورها را برای تمام موتورهای جستجو صادر میکنید. برای محدود کردن تنها گوگل باید از عبارت Googlebot به جای * استفاده کنید. Googlebot نام ربات معروف گوگل برای پیمایش صفحات است. Googlebot-Image ربات گوگل برای پیمایش تصاویر سایت است. اگر قصد دارید دستوراتی را برای پیمایش تصاویر سایت خود صادر کنید از این ربات استفاده کنید.

Disallow نیز آدرس صفحهای که قرار است نادیده بگیرید را مشخص میکند.

چند مثال از فایل robots.txt:

User-agent: Googlebot-Image

Disallow: /دستور فوق باعث نادیده گرفتن بررسی تمامی تصاویر سایت میشود.

User-agent: Googlebot-Image

Disallow: /*.jpg$دستور فوق باعث نادیده گرفتن تمام تصاویر jpg سایت میشود.

User-agent: *

Sitemap: https://hitos.ir/sitemap.xmlدستور فوق باعث مشخص شدن آدرس نقشه سایت برای موتورهای جستجو میشود.

در بخش robots.txt ابزاری برای test این فایل موجود است که میتوانید از آن استفاده کنید.

البته غیر از استفاده از فایل robots میتوانید تگ متایی برای عدم بررسی موتور جستجو به سایت خود اضافه کنید:

<meta name="googlebot" content="noindex" />تگ متای فوق مانع پیمایش ربات googlebot درون صفحه شما میشود.

<meta name="robots" content="noindex" />تگ متای فوق مانع پیمایش تمام رباتهای استاندارد درون صفحه شما میشود.

بخش Sitemap و آموزش ساخت Sitemap سایت

نقشه سایت یا سایت مپ یک فایل xml است که آدرس تمام صفحات مهم سایت در آن درج شده است. اگر از سایت مپ استفاده کنید احتمال میرود هیچ صفحهای از سمت گوگل مغفول نماند.

چگونه یک فایل sitemap استاندارد بسازیم؟

برای داشتن یک sitemap استاندارد به قالب زیر توجه کنید:

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://hitos.ir/what-is-search-console-search-appearance-part-2</loc>

<lastmod>2016-10-05T18:10:06+03:30</lastmod>

</url>

</urlset>در فوق برچسب url یک برچسب اصلی است که اطلاعات هر لینک را در خود جای میدهد. در این برچسب میتوان زیر برچسبهای زیر را به کار برد:

برچسب <loc> حاول لینک دقیق صفحه است که وجود آن الزمایست و طول آن حداکثر میتوان 2048 کاراکتر باشد.

برچسب <lastmod> حاوی تاریخ آخرین تغییر در صفحه است که وجود آن الزامی نیست.

در مثال فوق تنها این دو برچسب را استفاده کرده ایم ولی میتوانیم برچسبهای غیر الزامی دیگری را نیز استفاده کنیم که در ادامه داریم:

برچسب <changefreq> که بازه زمانی تغییرات این صفحه را دریافت میکند که میتواند از 0.0 تا 1.0 نام گذاری شود.

برچسب <priority> که میزان اهمیت این آدرس را در بازه 0.0 تا 1.0 مشخص میکند.

از changefreq و priority محتاطانه استفاده کنید چون ممکن است گوگل به سایت مپ شما کم اعتماد شود. خیلیها از این برچسبها کاملا صرف نظر میکنند.

پیشنهاد میشود حجم هر صفحه sitemap بیشتر از 10 مگابایت نباشد. در ضمن نباید در هر صفحه سایتمپ به بیش از 5000 لینک آدرس دهی شود. اگر سایت مپ سایت شما بدلیل بزرگی سایتتان بیش از 5000 صفحه داشت میتوانید فایلهای sitemap جداگانه تعریف کنید. مثلا https://site.com/sitemap1.xml و https://site.com/sitemap2.xml.

اگر نقشه سایت شما آماده است در بخش sitemap گوگل سرچ کنسول باید این سایت مپ را ابتدا تست و در نهایت اضافه کنید.

بخش URL Parameters گوگل سرچ کنسول:

این بخش مربوط به الگوبندی لینک صفحات شماست. هیچ گاه برای تست تغییری در این بخش ندهید چون ممکن است روی URLهای سایت شما تاثیر منفی بگذارد. در آینده در یک پست اختصاصی به این بخش میپردازیم.

بخش Security Issues گوگل سرچ کنسول:

در این بخش هشدارهای امنیتی که توسط گوگل رصد شده اند به شما نمایش داده میشود.

بخش Other Resources گوگل سرچ کنسول:

این بخش شامل معرفی ابزارهای دیگر برای بررسی عملکرد سایت شماست.

Structured Data Testing Tool: این ابزار بخش Structured Data سایت شما را validate میکند و اگر مشکلی وجود داشته باشد به شما اطلاع میدهد.

Structured Data Markup Helper: این ابزار به شما نحوه مارک کردن اطلاعات یک صفحه برای Structed Data را آموزش میدهد.

Email Markup Tester: این ابزار معتبر بودن دستورات html ایمیل شما را معین میکند.

Google My Business: این بخش برای تعریف هویت تجاری برای کسب و کار شماست. شما با این بخش میتوانید برای کسب و کار خود یک هویت تجاری مجازی بسازید و اگر کسی نام شما را جستجو کرد قسمت سمت چپ نتایج جستجو نمایش میدهد.

Google Merchant Center: در این بخش که مربوط به کسب و کارهای فروش آنلاین است به این گونه کاربران کمک میکند تا محصولات خود را به صورت بهینه تری بفروش برسانند.

PageSpeed Insights: این ابزار سرعت سایت شما را بررسی میکند و به شما راهکارهایی برای افزایش سرعت وبسایت را میدهد.

Custom Search: این ابزار برای شما یک جستجوگر بر مبنای گوگل میدهد. خیلی از سایتهای معتبر مانند سایت معتبر فعال در زمینه سئو moz.com نیز این جستجو استفاده میکند.

Google Domains: سامانه جستجوگر دامنه گوگل که به شما در ایجاد یک سایت ساده کمک میکند.

Webmaster Academy: در این بخش یک دوره کوتاه ولی کاربردی در زمینه استفاده از ابزار Google Search Console میگذرانید. در پایان هر بخش از این دوره یک آزمون از شما گرفته میشود.

تگ ها: keywordgoogleGoogle Search Console